2024-02-12 13:31 点击次数:155

詈骂期记挂Long Short Term Memory(LTSM)是Hochreiter&Schmidhuber策画的递归神经汇聚的翻新版块。LSTM止境合适序列瞻望任务,况且擅长捕捉永久有关性。它的期骗推广到波及工夫序列和序列的任务。LSTM的上风在于它大略掌捏对惩处复杂问题(如机器翻译和语音识别)至关蹙迫的端正依赖性。本文对LSTM进行了长远的先容kaiyun,涵盖了LSTM模子、体绑缚构、责任旨趣以及它们在各式期骗中进展的关键作用。

什么是LSTM?

传统的RNN有一个历程工夫的单一遮掩情状,这会使汇聚难以学习永久依赖联系。LSTM通过引入存储单位来惩处这个问题,存储单位是一个不错长工夫保存信息的容器。LSTM汇聚大略学习序列数据中的永久有关性,这使其止境合适于话语翻译、语音识别和工夫序列瞻望等任务。LSTM还不错与其他神经汇聚架构聚合使用,举例用于图像和视频分析的卷积神经汇聚(CNNs)。

存储单位由三个门限度:输初学、渐忘门和输外出。这些门决定向存储单位添加什么信息、从存储单位删除什么信息以及从存储单位输出什么信息。输初学限度哪些信息被添加到存储器单位。渐忘门限度从存储单位中移除哪些信息。况且输外出限度从存储器单位输出什么信息。这使得LSTM汇聚大略在信息流经汇聚时遴荐性地保留或丢弃信息,从而学习永久依赖联系。

双向LSTM(Bidirectional LSTM)

双向LSTM(Bi-LSTM/BLSTM)是一种大略处理前向和后向序列数据的递归神经汇聚(RNN)。这使得Bi-LSTM大略比传统LSTM学习序列数据中更长限制的依赖联系,传统LSTM只可在一个方进取处理序列数据。

Bi-LSTM由两个LSTM汇聚构成,一个在正向处理输入序列,另一个在反向处理输入序列。然后,两个LSTM汇聚的输出被组合以产生最终输出。Bi-LSTM已被领路注解在各式任务上得回了开始进的成果,包括机器翻译、语音识别和文本纲领。

LSTM不错堆叠以创建深度LSTM汇聚,该汇聚不错学习序列数据中更复杂的方式。每个LSTM层拿获输入数据中不同级别的轮廓和工夫依赖性。

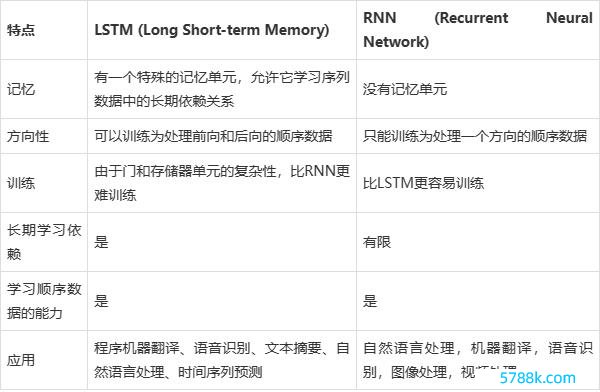

LTSM vs RNNkaiyun